OpenMythos intenta reconstruir Claude Mythos y pone de moda los transformers en bucle

Anthropic no ha publicado la arquitectura de Claude Mythos Preview, su modelo más potente y todavía restringido a una vista previa de investigación cerrada para trabajos de ciberseguridad defensiva. La propia compañía lo presenta como su frontier model más capaz hasta la fecha, pero no ha abierto los detalles internos de diseño que explican ese salto. Ese vacío técnico es precisamente el que intenta llenar s, un proyecto open source en PyTorch que se define como una reconstrucción teórica, comunitaria e independiente de lo que podría haber detrás de Mythos.

La propuesta no es un leak, ni un clon, ni una implementación oficial. El propio repositorio avisa de que se trata de una reconstrucción basada en literatura pública y especulación razonada, sin afiliación con Anthropic. Aun así, el interés que ha despertado tiene lógica: más allá del nombre, OpenMythos sirve como banco de pruebas para una idea que empieza a ganar peso en la investigación de modelos de lenguaje, la de los llamados recurrent-depth transformers o looped transformers, es decir, arquitecturas que reutilizan un mismo bloque varias veces dentro de una sola pasada de inferencia para ganar profundidad de razonamiento sin disparar el número de parámetros almacenados.

Un transformer que piensa por vueltas, no por capas nuevas

La hipótesis central de OpenMythos es que Claude Mythos podría apoyarse en una arquitectura de tipo Recurrent-Depth Transformer. En lugar de apilar cientos de capas distintas, el modelo dividiría su estructura en tres partes —Prelude, bloque recurrente y Coda— y haría pasar el estado oculto por ese núcleo recurrente varias veces, compartiendo pesos entre iteraciones. Según el repositorio, ese bucle puede combinarse con una mezcla de expertos o MoE en la parte feed-forward, lo que permitiría sumar profundidad de razonamiento por recurrencia y amplitud de capacidades por enrutado selectivo de expertos.

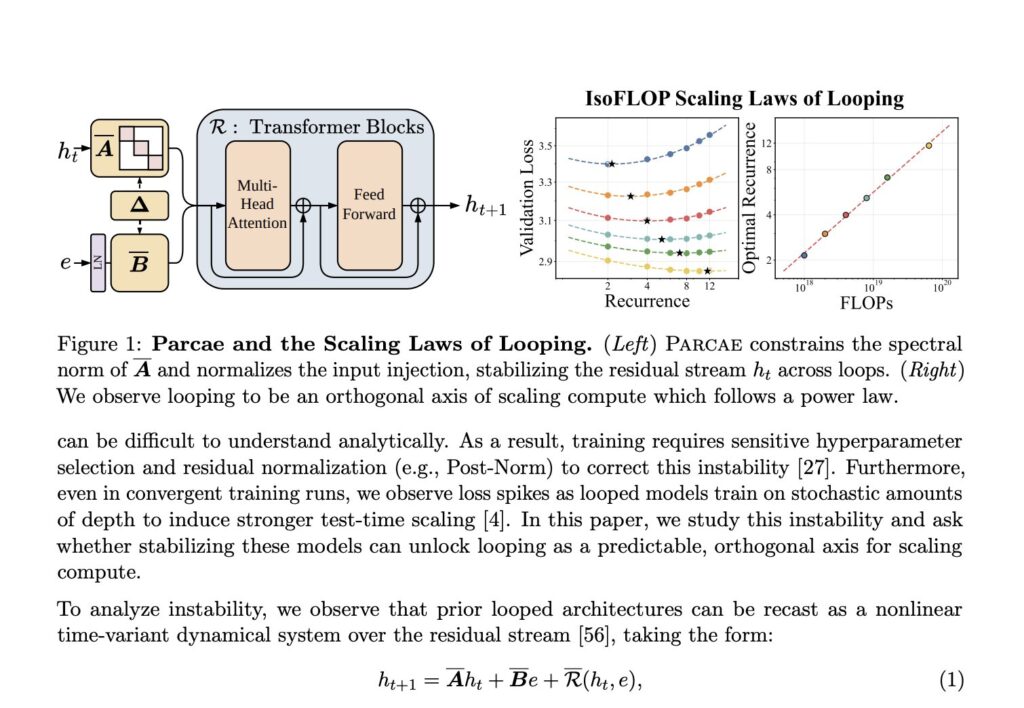

Sobre el papel, la tesis es sugerente porque encaja con varias líneas recientes de investigación. El paper Loop, Think, & Generalize mostró este mismo mes que los recurrent-depth transformers mejoran en tareas de generalización sistemática y extrapolación de profundidad, es decir, pueden razonar sobre composiciones nuevas y beneficiarse de más iteraciones en inferencia para resolver cadenas de razonamiento más largas. En paralelo, Parcae ha defendido que estos modelos pueden entrenarse de forma estable si se controla bien la dinámica del bucle y que, a igualdad de presupuesto, la recurrencia puede ofrecer una relación calidad-parámetros más favorable que la de un transformer fijo tradicional.

Eso no significa, conviene subrayarlo, que Anthropic haya confirmado nada parecido para Mythos. Lo que existe hoy es una combinación de hechos y conjeturas: Anthropic sí ha confirmado la existencia de Mythos Preview, su disponibilidad limitada en investigación cerrada y su papel central en Project Glasswing; OpenMythos, por su parte, toma la investigación más reciente sobre arquitecturas en bucle, mezcla de expertos y razonamiento implícito en espacio latente para proponer una implementación plausible de ese tipo de modelo. La distancia entre una hipótesis elegante y la arquitectura real de un sistema comercial sigue siendo grande.

Qué aporta realmente OpenMythos al debate técnico

Más allá del reclamo de “reconstruir Mythos”, el valor real del proyecto está en lo que pone sobre la mesa para la comunidad técnica. El repositorio ofrece una implementación configurable en PyTorch con atención intercambiable entre MLA y GQA, bloque recurrente con reinyección estable de la entrada, MoE con expertos enrutados y expertos compartidos, adaptadores LoRA por profundidad y configuraciones predefinidas que van desde 1B hasta 1T de parámetros teóricos. También incluye scripts de entrenamiento sobre FineWeb-Edu y documentación orientada a experimentar con profundidad de bucle, estabilidad y escalado en inferencia.

Ese enfoque convierte a OpenMythos en algo más interesante que un simple ejercicio de branding sobre Claude. En la práctica, funciona como un laboratorio abierto para explorar una de las preguntas más importantes del momento en arquitectura de modelos: si la siguiente mejora grande vendrá de escalar parámetros y datos, o de reutilizar mejor el cómputo en inferencia. Parcae aporta munición a esta segunda vía al señalar que, en ciertos regímenes, un modelo looped de 770M parámetros puede acercarse al rendimiento de un transformer fijo de 1,3B entrenado sobre el mismo presupuesto. Es una diferencia que no prueba nada sobre Anthropic, pero sí explica por qué este tipo de ideas ha dejado de parecer marginal.

También hay una segunda derivada importante: el razonamiento implícito. Frente a la cadena de pensamiento visible en tokens, buena parte de esta nueva literatura defiende que un modelo en bucle puede resolver pasos intermedios dentro del espacio latente, sin emitir texto en cada etapa. OpenMythos adopta precisamente esa visión y la conecta con la idea de que más iteraciones en inferencia equivaldrían a más profundidad de razonamiento. Es una propuesta atractiva para cargas de trabajo donde interesa pensar más sin inflar el modelo completo, aunque también trae consigo problemas clásicos como el “overthinking”, la inestabilidad del estado oculto o la necesidad de mecanismos de parada adaptativa.

Entre la investigación seria y el hype de la comunidad

Como sucede a menudo en IA, el principal riesgo está en mezclar indicios sólidos con exceso de narrativa. OpenMythos bebe de papers recientes y de ideas técnicamente defendibles, pero también se apoya en una inferencia ambiciosa: que esas piezas podrían explicar el comportamiento observado o atribuido a Mythos. A día de hoy, Anthropic no ha publicado un paper diciendo que su modelo use exactamente un RDT con MoE, MLA, inyección LTI estable y ACT halting. Lo que sí ha publicado es una system card, notas de lanzamiento y materiales de evaluación donde queda claro que Mythos Preview existe, que es más capaz que el resto de su gama en ciertos ámbitos y que la empresa sigue tratándolo como un modelo de acceso muy controlado.

Por eso OpenMythos interesa, sobre todo, como termómetro de hacia dónde mira ahora la comunidad. Ya no basta con preguntar cuántos parámetros tiene un modelo. La conversación se está desplazando hacia cuánto cómputo usa por token, cuánta profundidad gana en inferencia, cómo reparte expertos, cómo comprime memoria de atención y cómo estabiliza ciclos internos de razonamiento. Si Anthropic ha encontrado realmente una combinación novedosa en esa dirección, OpenMythos no la revela. Pero sí ayuda a entender por qué el debate sobre la próxima gran arquitectura ya no gira solo alrededor de “más grande” y empieza a hacerlo alrededor de “más recurrente, más selectiva y más eficiente”.

Preguntas frecuentes

¿Qué es OpenMythos exactamente?

Es un proyecto open source en PyTorch que se presenta como una reconstrucción teórica e independiente de la arquitectura de Claude Mythos, basada en literatura pública y no en información oficial filtrada de Anthropic.

¿Anthropic ha confirmado que Claude Mythos use esta arquitectura?

No. Anthropic ha confirmado la existencia de Claude Mythos Preview y ha publicado materiales de seguridad y evaluación, pero no ha hecho pública su arquitectura interna.

¿Qué tiene de especial un recurrent-depth transformer?

Reutiliza un mismo bloque varias veces dentro de una sola pasada, lo que puede aumentar la profundidad de razonamiento en inferencia sin multiplicar el número de parámetros almacenados como en un transformer tradicional de capas fijas.

¿Por qué este proyecto está llamando tanto la atención?

Porque coincide con una ola reciente de papers que apuntan a que los modelos en bucle pueden mejorar en generalización, razonamiento implícito y eficiencia de escalado, y porque ofrece una base abierta para experimentar con esas ideas.

Introducing OpenMythos

An open-source, first-principles theoretical reconstruction of Claude Mythos, implemented in PyTorch.

The architecture instantiates a looped transformer with a Mixture-of-Experts (MoE) routing mechanism, enabling iterative depth via weight sharing and… r

— Kye Gomez (swarms) (@KyeGomezB) 6

Lascia un commento