Kimi K2.6 aprieta a GPT-5.4 y Claude en código y agentes, pero no gana en todo

Moonshot AI ha presentado Kimi K2.6 como su nuevo gran movimiento en modelos abiertos para programación y flujos agentic. La compañía asegura que lo libera como open source y lo pone a disposición a través de Kimi.com, la app, la API y Kimi Code, con un discurso muy claro: más capacidad en coding, mejor ejecución de tareas largas y una arquitectura pensada para agentes que trabajan durante horas, no solo para responder a un prompt corto.

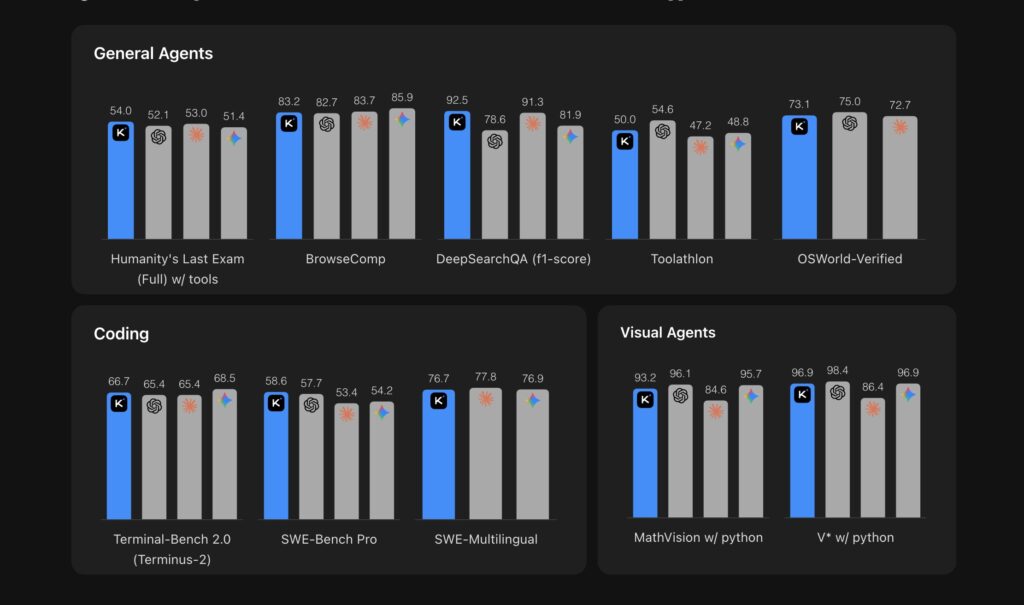

La promesa es ambiciosa, pero lo interesante aquí no es el eslogan, sino la comparación. Según la tabla oficial publicada por Moonshot AI, Kimi K2.6 ya compite de tú a tú con GPT-5.4, Claude Opus 4.6 y Gemini 3.1 Pro en varios benchmarks de agentes, programación y visión. No arrasa en todo, pero sí logra algo que hace un año parecía mucho más lejano para un modelo abierto: ponerse en la conversación seria con los pesos pesados cerrados del sector.

Donde Kimi K2.6 sí aprieta de verdad

La foto más favorable para Moonshot está en benchmarks de agentes con herramientas y en varios tests de código. En la tabla oficial, Kimi K2.6 logra un 54,0 en Humanity’s Last Exam con herramientas, por encima de GPT-5.4 con 52,1, de Claude Opus 4.6 con 53,0 y de Gemini 3.1 Pro con 51,4. En DeepSearchQA también saca ventaja con 92,5 de F1, por delante de Claude 91,3, Gemini 81,9 y GPT-5.4 con 78,6. En SWE-Bench Pro, orientado a tareas de ingeniería de software, firma 58,6 frente a 57,7 de GPT-5.4, 54,2 de Gemini y 53,4 de Claude.

Eso no significa que domine toda la tabla. En BrowseComp, Gemini 3.1 Pro sigue por delante con 85,9 frente a 83,2 de K2.6. En Toolathlon, GPT-5.4 gana con 54,6 frente a 50,0. En OSWorld-Verified, GPT-5.4 también queda por delante con 75,0 frente a 73,1. Y en razonamiento puro, especialmente en pruebas como AIME 2026, HMMT 2026 o GPQA-Diamond, K2.6 compite bien, pero no lidera frente a GPT-5.4 o Gemini. Dicho de otra manera: Moonshot tiene argumentos sólidos para hablar de salto generacional, pero no para vender un dominio absoluto.

La siguiente tabla resume los datos más relevantes publicados por Moonshot AI:

| Benchmark | Kimi K2.6 | GPT-5.4 | Claude Opus 4.6 | Gemini 3.1 Pro | Lectura rápida |

|---|---|---|---|---|---|

| HLE-Full w/ tools | 54,0 | 52,1 | 53,0 | 51,4 | K2.6 lidera |

| DeepSearchQA (F1) | 92,5 | 78,6 | 91,3 | 81,9 | K2.6 lidera con claridad |

| Toolathlon | 50,0 | 54,6 | 47,2 | 48,8 | GPT-5.4 gana |

| OSWorld-Verified | 73,1 | 75,0 | 72,7 | — | GPT-5.4 gana por poco |

| Terminal-Bench 2.0 | 66,7 | 65,4 | 65,4 | 68,5 | Gemini gana; K2.6 supera a GPT y Claude |

| SWE-Bench Pro | 58,6 | 57,7 | 53,4 | 54,2 | K2.6 lidera |

| SWE-Multilingual | 76,7 | — | 77,8 | 76,9 | Claude gana por poco |

| V* w/ python | 96,9 | 98,4 | 86,4 | 96,9 | GPT-5.4 gana; K2.6 empata con Gemini |

Moonshot aclara además que parte de las puntuaciones de rivales marcadas con asterisco fueron re-evaluadas por la propia compañía y que, para reproducir los resultados oficiales de K2.6, recomienda usar su API oficial. Eso obliga a leer la comparativa con el mismo criterio que cualquier benchmark de proveedor: es útil para ver tendencia, pero no sustituye una validación completamente independiente.

El argumento más fuerte no está solo en la tabla, sino en la duración

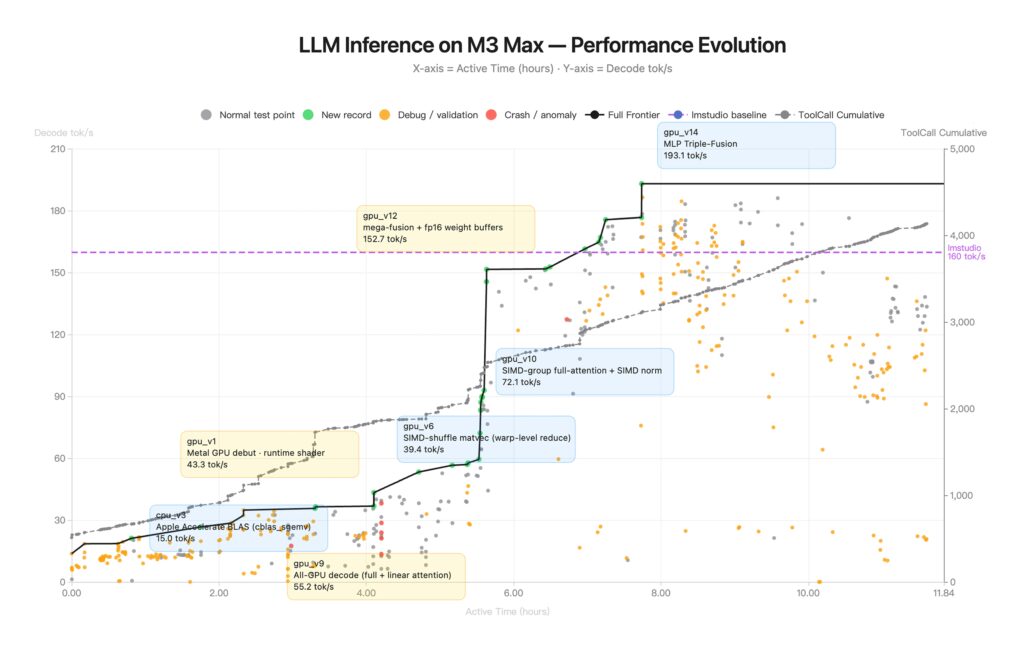

Donde Kimi K2.6 intenta diferenciarse de verdad es en el llamado long-horizon coding. Moonshot no se limita a enseñar un benchmark clásico, sino que publica dos casos de uso largos y llamativos. En el primero, K2.6 descargó y desplegó localmente Qwen3.5-0.8B en un Mac, reescribiendo y optimizando inferencia en Zig durante más de 12 horas, con más de 4.000 tool calls y 14 iteraciones, hasta pasar de unos 15 tokens por segundo a unos 193 tokens por segundo, alrededor de un 20 % por encima de LM Studio según la compañía. En el segundo, rehizo el motor financiero open source exchange-core durante 13 horas, aplicó 12 estrategias de optimización, ejecutó más de 1.000 tool calls y modificó más de 4.000 líneas de código, con una mejora del 185 % en throughput medio y del 133 % en throughput de rendimiento.

Esos números son precisamente los que reflejan las capturas comparativas que acompañan el lanzamiento: una gráfica de evolución en M3 Max donde el modelo va subiendo desde 15 hasta 193 tok/s, y un panel de barras donde aparece por delante o muy cerca de modelos cerrados en varios tests de agentes, coding y visión. Son casos publicados por Moonshot y no auditorías de terceros, pero ayudan a entender el enfoque del producto: no vender solo respuestas inteligentes, sino resistencia operativa en sesiones muy largas.

| Caso de uso publicado por Moonshot | Duración | Tool calls | Resultado |

|---|---|---|---|

| Optimización de inferencia local de Qwen3.5-0.8B en Mac | 12+ horas | 4.000+ | De ~15 a ~193 tok/s |

| Reingeniería de exchange-core | 13 horas | 1.000+ | +185 % en throughput medio; +133 % en throughput de rendimiento |

| Agente autónomo interno para operaciones de infraestructura | 5 días | No especificado | Gestión continua de monitorización, incidentes y operaciones |

Agentes en enjambre: 300 subagentes y 4.000 pasos

Otro de los mensajes de lanzamiento gira alrededor del Agent Swarm. Moonshot asegura que K2.6 amplía su arquitectura de enjambre hasta 300 subagentes y 4.000 pasos coordinados, muy por encima de los 100 subagentes y 1.500 pasos que la propia empresa atribuía a K2.5 en su blog anterior. El objetivo aquí no es solo repartir tareas, sino componer trabajo heterogéneo: búsqueda, análisis documental, redacción, generación de webs, presentaciones, hojas de cálculo y coordinación entre agentes y humanos.

Ese es, probablemente, el elemento más estratégico del anuncio. Moonshot ya no está compitiendo solo en “modelo base”, sino en la idea de sistema operativo agentic: un modelo que no se limita a completar código o responder preguntas, sino que coordina agentes, reutiliza documentos como skills y mantiene contexto en tareas que duran días. La propia compañía sostiene que su equipo de infraestructura RL utilizó un agente respaldado por K2.6 durante cinco días seguidos para monitorización, respuesta a incidentes y operaciones de sistemas. Es una afirmación llamativa y todavía difícil de medir desde fuera, pero encaja con la tendencia del mercado hacia agentes persistentes y no solo asistentes conversacionales.

Lo que este lanzamiento sí cambia

El verdadero valor de Kimi K2.6 no está en demostrar que ya haya derrotado a GPT-5.4, Claude o Gemini en todos los frentes, porque no es así. Está en otra cosa: mostrar que un modelo abierto puede ser ya una opción seria en coding largo, workflows agentic y tareas con herramientas, incluso frente a los sistemas cerrados más conocidos. Eso es importante para desarrolladores, startups y plataformas que buscan rendimiento alto sin quedar totalmente atados a un proveedor propietario.

También cambia el tono del debate. Ya no basta con decir que un modelo open source “se acerca” a los cerrados. En algunos tests concretos, K2.6 va por delante. En otros, pierde por poco. Y en otros sigue claramente por detrás. Esa mezcla, bien leída, es mucho más interesante que el titular fácil: indica que la brecha sigue existiendo, pero ya no tiene la misma forma ni el mismo tamaño en todos los dominios.

Preguntas frecuentes

¿Kimi K2.6 supera de verdad a GPT-5.4 y Claude?

En algunos benchmarks concretos sí, sobre todo en HLE con herramientas, DeepSearchQA y SWE-Bench Pro, según los datos publicados por Moonshot AI. En otros sigue por detrás, especialmente frente a Gemini o GPT-5.4 en ciertas pruebas de razonamiento, visión o uso de herramientas.

¿Qué significa que sea open source en este contexto?

Moonshot afirma que está open sourcing Kimi K2.6 y que el modelo está disponible en sus distintos canales. Aun así, el anuncio se centra más en disponibilidad y benchmarks que en detallar en esa página la política completa de pesos, licencia y distribución técnica.

¿Qué es lo más diferencial de Kimi K2.6 frente a K2.5?

Según Moonshot, el salto más claro está en long-horizon coding, en la coordinación de enjambres de agentes y en la fiabilidad durante ejecuciones muy largas, con mejoras visibles también en benchmarks de código y agentes respecto a K2.5.

¿Se pueden tomar estas tablas como una verdad absoluta?

No. Son comparativas oficiales del propio proveedor. Son útiles para ver por dónde quiere posicionarse K2.6, pero deben leerse con cautela, especialmente cuando algunas puntuaciones de competidores han sido re-evaluadas por la propia Moonshot.

Lascia un commento